Indice

Le versioni compatte del nuovo modello puntano su efficienza e scalabilità: l’AI diventa davvero per tutti.

Dopo il lancio del modello principale, OpenAI spinge subito sull’acceleratore con una strategia chiara: portare l’intelligenza artificiale ovunque, non solo nei contesti premium.

Nascono così GPT 5.4 mini e GPT 5.4 nano, due versioni compatte pensate per rispondere a un’esigenza sempre più concreta: avere modelli veloci, economici e integrabili in qualsiasi tipo di applicazione. Non è solo una semplificazione tecnica. È un cambio di approccio.

GPT 5.4 mini: il compromesso intelligente

Il vero protagonista è GPT 5.4 mini, una versione che punta a mantenere un livello di prestazioni molto vicino al modello completo, ma con tempi di risposta nettamente più rapidi.

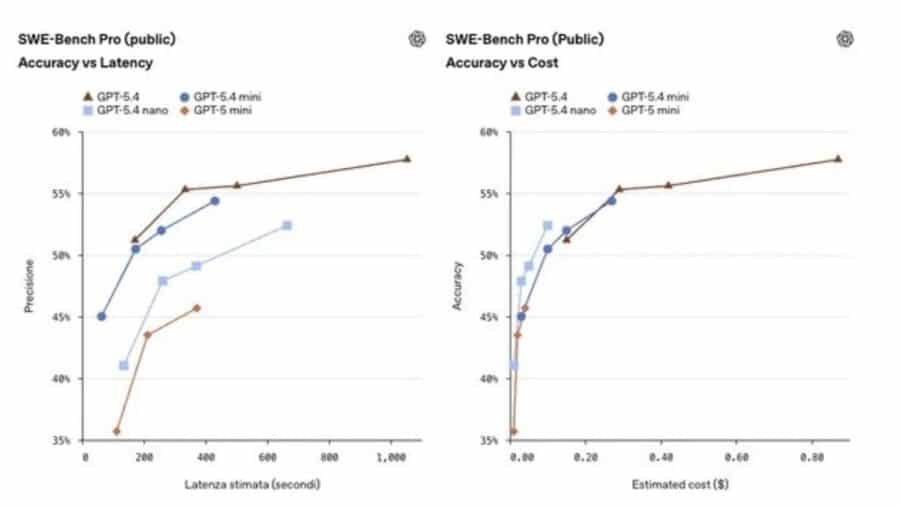

Secondo quanto dichiarato, è circa due volte più veloce rispetto alla generazione precedente nella stessa fascia, con miglioramenti evidenti nelle aree che oggi contano davvero: programmazione, ragionamento e utilizzo degli strumenti.

Il punto interessante è che, in alcuni benchmark, le performance si avvicinano sorprendentemente a quelle del modello principale. Questo significa che per molte attività quotidiane non è più necessario usare un modello “pesante”.

E infatti il posizionamento è chiaro: GPT 5.4 mini diventa il motore perfetto per task operativi, quelli che devono essere eseguiti rapidamente, senza sacrificare troppo in termini di qualità.

Dividere il lavoro tra modelli

Dietro questa scelta c’è una logica precisa. I modelli più grandi vengono utilizzati per pianificare, ragionare e prendere decisioni complesse. Le versioni mini, invece, si occupano dell’esecuzione, gestendo attività rapide e ripetitive.

È un modello operativo che ricorda sempre di più un’organizzazione reale, dove esistono livelli diversi di specializzazione. E questo apre scenari interessanti per lo sviluppo di sistemi più complessi, basati su più agenti che collaborano tra loro.

GPT 5.4 nano: velocità pura per task semplici

Se il mini rappresenta il compromesso, GPT 5.4 nano è l’estremo opposto. Qui l’obiettivo è uno solo: massimizzare velocità ed efficienza. È il modello pensato per tutte quelle operazioni che devono essere eseguite su larga scala, come classificazione, estrazione dati o ranking.

Non è progettato per ragionamenti complessi, ma per fare bene e velocemente compiti specifici. Ed è proprio questo il suo valore, soprattutto in contesti enterprise o in applicazioni ad alto volume.

Disponibilità: l’AI scende di livello

Uno degli aspetti più rilevanti riguarda la distribuzione. GPT 5.4 mini non resta confinato ai piani premium, ma arriva anche nella versione gratuita di ChatGPT e nei piani base. È una scelta strategica che abbassa la barriera d’ingresso e amplia enormemente la platea.

Il nano, invece, è pensato principalmente per sviluppatori e aziende, ed è disponibile tramite API, con costi inferiori rispetto al modello completo.

In entrambi i casi, il messaggio è chiaro: l’AI deve diventare più accessibile, non solo più potente.

Efficienza batte potenza

Negli ultimi anni la corsa all’intelligenza artificiale è stata dominata da modelli sempre più grandi e complessi. Ora il paradigma sta cambiando.

Non vince più chi ha il modello più potente in assoluto, ma chi riesce a trovare il miglior equilibrio tra prestazioni, velocità e costi. Con GPT 5.4 mini e nano, OpenAI sta spostando il focus proprio su questo equilibrio, rendendo possibile l’integrazione dell’AI in contesti dove prima non era sostenibile.

Una strategia che guarda lontano

Questa mossa racconta molto di più di un semplice aggiornamento. Significa che l’intelligenza artificiale sta entrando in una fase più matura, dove non basta essere impressionanti, bisogna essere utili, veloci e sostenibili.

E soprattutto significa che l’AI non è più solo per pochi, ma inizia davvero a diventare una tecnologia diffusa, integrata e quotidiana.