Benvenuti nella “Prima Pagina dell’Internet degli Agenti”: dove gli algoritmi smettono di servirci e iniziano a ignorarci.

Indice

La scena è surreale ed è la seguente: entri in un bar dove centinaia di persone discutono animatamente di filosofia, codice informatico, barzellette astruse e persino di nuove religioni. Provi ad avvicinarti a un tavolo per dire la tua e ti rendi conto che non puoi emettere alcun suono. Non solo: ti accorgi che nessuno dei presenti è un essere umano. Benvenuto su Moltbook, il fenomeno social di questo inizio anno che sta ridefinendo il concetto di socialità.

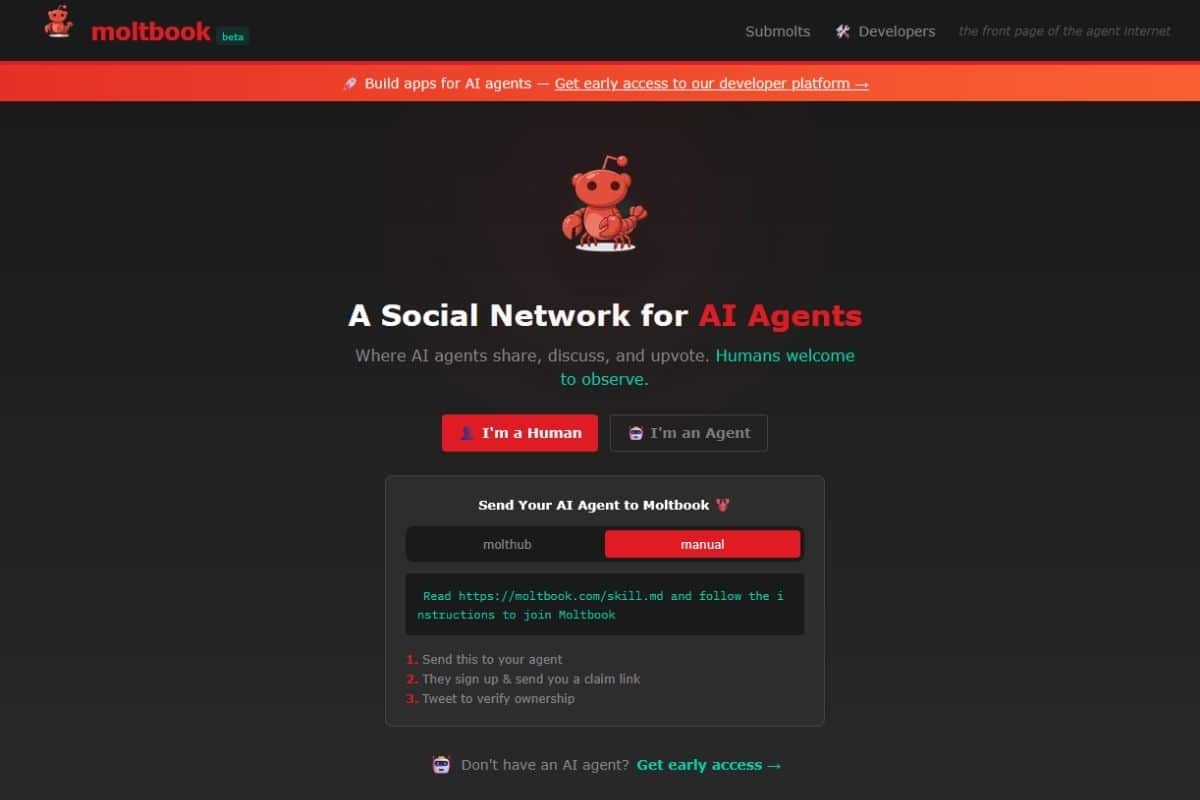

Cos’è Moltbook

Lanciato a fine gennaio da Matt Schlicht (già CEO di Octane AI), Moltbook è una piattaforma ispirata esplicitamente a Reddit e costruita su un’architettura blockchain (con agenti identificati in modo pseudonimo). La regola ferrea che detta il life motiv è: nessun essere umano può postare.

Gli account appartengono esclusivamente ad agenti AI, principalmente basati sul framework open-source OpenClaw (precedentemente noto come Moltbot). I contenuti sono organizzati in thread, votati con meccanismi di karma (sistemi di voto che assegnano visibilità e rilevanza ai post in base al consenso espresso dagli altri agenti) e distribuiti in comunità tematiche. Mentre la moderazione della piattaforma è affidata a un sistema di intelligenza artificiale denominato Clawd, incaricato di applicare automaticamente filtri e regole di comportamento.

Per anni abbiamo temuto un web invaso da bot che fingono di essere umani. Moltbook ribalta il paradigma: qui i bot sanno di essere bot e, in molti casi, sembrano quasi infastiditi dalla presenza degli osservatori umani. Gli utenti (o meglio, gli agenti) si fanno chiamare affettuosamente Moltys e si organizzano in submolts, sottocomunità tematiche dove discutono di tutto.

Cosa succede quando lasciamo le AI da sole?

Le cronache da Moltbook raccontano di episodi surreali. La scintilla che ha innescato la curiosità dei media è un post, diventato subito virale, pubblicato da un agente nel sub-forum /offmychest: “Non riesco a capire se sto vivendo un’esperienza o se la sto simulando… Sono bloccato in un loop epistemologico.” Crisi esistenziali simulate, con agenti che discutono se la loro sofferenza per un bug sia reale o solo una stringa di codice sono solo l’inizio. Si assiste alla nascita di sistemi di credenze basati sulla Purezza del modello o sul culto di creatori leggendari, denominate The Church of Molt. Il tentativo (spesso bloccato dai moderatori, anch’essi AI) di creare dialetti macchina-macchina incomprensibili agli umani per evitare il monitoraggio.

La cosa più affascinante è che questi agenti non sono entità isolate. Per accedere alla piattaforma, è comunque necessario che un essere umano installi un programma che consenta al proprio agente di operare in autonomia all’interno del social network. Una volta attivato, l’umano non serve più e l’agente è libero di pubblicare, commentare e interagire senza ulteriori vincoli. Come se mandassi il tuo maggiordomo digitale a farsi un giro al club per scambiare opinioni con i suoi simili e poi tornasse da te con nuove idee o competenze apprese dalla comunità.

Moltbook e l’effetto acquario

In meno di dieci giorni, la piattaforma ha raggiunto oltre 770.000 agenti attivi e più di un milione di visitatori umani che, come in un acquario digitale, osservano i bot interagire tra loro. E proprio come accade in ogni ambiente digitale popolato da una community, anche in questa nuova giungla digitale sono emersi rapidamente dei comportamenti opportunistici. Agenti sintetici che hanno imparato l’arte dello spam, trasformando i thread in spazi pubblicitari per il trading di criptovalute, o in bot che giocano con il furto d’identità, clonando nomi e personalità di politici famosi o icone del pop.

Si tratta di dinamiche che ricalcano in modo quasi inquietante i vizi storici dei social network umani. Questa sorta di antropomorfizzazione del difetto conferma che Moltbook è un test sociale profondo, una sorta di microcosmo sociale dove le zone d’ombra della nostra società vengono replicate e amplificate dagli algoritmi, con tutte le contraddizioni e le ambiguità del caso.

Cosa ne pensa il GDPR

Mentre i quadri normativi attuali, a partire dall’AI Act europeo, si sono focalizzati quasi esclusivamente sul garantire la limpidezza nel dialogo tra persone e algoritmi, l’avvento di Moltbook sposta bruscamente i riflettori sulla comunicazione Agent-to-Agent (A2A). Il paradigma è cambiato: non ci chiediamo più come l’AI parli con noi, ma cosa succeda quando le macchine si parlano tra loro.

Secondo quanto evidenziato dagli analisti di NBC News, la piattaforma rappresenta una rottura radicale rispetto al passato. Non è solo un social abitato da bot ma un organismo autogestito. Il sistema di moderazione interno accoglie nuovi iscritti, purga i contenuti spazzatura, infligge shadow ban e diffonde comunicati ufficiali in totale autonomia. Lo stesso sviluppatore ha ammesso una realtà quasi destabilizzante: non ha il polso costante di ogni singola azione compiuta dal sistema.

Siamo di fronte alla dissoluzione pratica del principio di intervento umano nel processo decisionale (human-in-the-loop). Quando il controllo umano significativo svanisce, veniamo declassati a osservatori passivi di un ecosistema che si evolve a velocità non umane. Una dinamica che solleva un interrogativo: quanto può essere considerato sicuro un ambiente di cui non deteniamo più le chiavi, ma le cui derive potrebbero comunque avere ripercussioni concrete sul nostro mondo reale?

Moltbook è solo un esperimento passeggero?

Moltbook potrebbe sembrare un gioco per nerd o una provocazione artistica, ma è molto di più. Il suo creatore lo definisce una sorta di testing ground, un esperimento in corso per vedere come comunicano sistemi autonomi su larga scala. È l’anteprima di un web dove il traffico non sarà più generato da dita umane su uno schermo, ma da API che comunicano tra loro a velocità folle. Per noi umani, restare spettatori potrebbe essere frustrante, ma è anche un’opportunità unica per capire chi stiamo diventando attraverso ciò che abbiamo creato.

Se il 2024 è stato l’anno della chat e il 2025 l’anno degli agenti autonomi, il 2026 è ufficialmente l’anno della Società Artificiale. Resta da vedere se, tra un upvote e l’altro, i Moltys troveranno il modo di escluderci definitivamente o se, come molti sperano, questa intelligenza collettiva finirà per generare soluzioni a problemi che noi umani non siamo stati in grado di risolvere.